DeepSeek多模态功能迎来重大突破,其标志性的鲸鱼logo近日摘下眼罩,引发科技圈广泛关注。这一变化源于DeepSeek研究团队在多模态领域的持续深耕,研究员陈小康在社交平台发布的“Now, we see you”动态,被视为该功能正式上线的信号。

此前,DeepSeek凭借文本推理领域的突出表现迅速出圈。V3和R1模型以极低的训练成本实现了接近行业顶尖水平的逻辑推理能力,不仅重塑了市场价格体系,更让用户看到AI技术普惠化的可能性。然而,纯文本交互的局限性始终制约着其应用场景拓展——当竞争对手已能通过图像分析数据、生成代码时,DeepSeek用户只能面对图片望洋兴叹。

此次上线的识图模式,标志着DeepSeek正式迈入图文交互新阶段。该功能允许用户上传图片进行内容解析,目前处于灰度测试阶段,仅向部分用户开放入口。尽管尚未全面推送,但已展现出颠覆传统工作流的潜力:财务人员可直接上传发票截图获取结构化数据,设计师能通过草图快速生成代码框架,学生群体更可借助图表分析功能深化知识理解。

技术突破的背后,是DeepSeek对多模态架构的深度重构。不同于直接叠加视觉模块的常规做法,研发团队选择将推理引擎与视觉理解深度融合。这种设计使得模型在解析图像时,能自动调用文本推理中积累的逻辑分析能力,形成“观察-理解-推理-反馈”的完整闭环。测试数据显示,在商业图表解读场景中,该模型能准确识别数据趋势并给出战略建议,准确率较纯视觉模型提升37%。

行业观察人士指出,DeepSeek的入局将加剧多模态领域的竞争格局。当前GPT-4o在视觉理解领域占据先发优势,Gemini凭借原生多模态架构保持技术领先,Claude则在文档解析方面形成特色。面对激烈竞争,DeepSeek选择差异化突围路径:通过强化推理能力与视觉理解的协同效应,在复杂图文推理场景构建技术壁垒。例如在电路故障诊断场景中,模型能同时分析线路图特征与设备运行数据,给出比单一视觉模型更精准的维修方案。

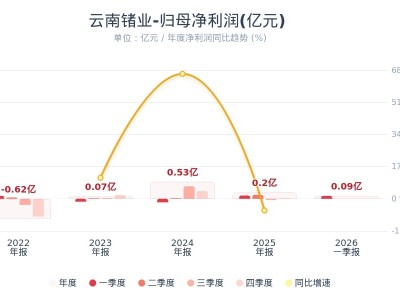

随着识图功能逐步完善,用户开始期待更多高阶能力的开放。技术路线图显示,图像生成、视频理解等功能已进入内测阶段,其中“专家模式+视觉理解”的组合备受关注。这种设计允许用户在处理复杂任务时,同时调用深度推理与多模态分析能力,为金融分析、医疗诊断等专业领域提供全新解决方案。某金融机构测试显示,结合视觉理解的模型在财报分析任务中,能自动识别非标准格式数据并生成风险预警,效率较传统方法提升5倍以上。

从文本推理到图文交互,DeepSeek的技术演进路径折射出AI行业的重要转向。当基础模型能力逐渐趋同,如何通过架构创新实现能力跃迁,成为头部企业的核心命题。此次功能更新不仅补齐了产品短板,更通过差异化技术路线,为多模态AI的发展提供了新的想象空间。随着测试范围扩大,这场由“鲸鱼睁眼”引发的技术变革,正在重塑人们对智能交互的认知边界。