腾讯混元团队携手腾讯音乐天琴实验室,近期宣布了一项重大技术突破:他们联合推出了开源的语音数字人模型——HunyuanVideo-Avatar。这一创新技术仅需用户的一张人物照片和一段音频,便能自动生成包含生动表情、精准唇形同步以及全身动作的动态视频。

HunyuanVideo-Avatar的核心在于腾讯混元视频大模型与MuseV技术的深度融合。该技术模型凭借其强大的多模态理解能力,能够精确解析用户提供的图像中的环境信息和音频中的情感内容,从而生成与输入高度匹配的视频内容。例如,当用户上传一张女性在海滩弹奏吉他的照片并配以抒情音乐时,系统能够智能识别并生成相应的海边弹唱视频。

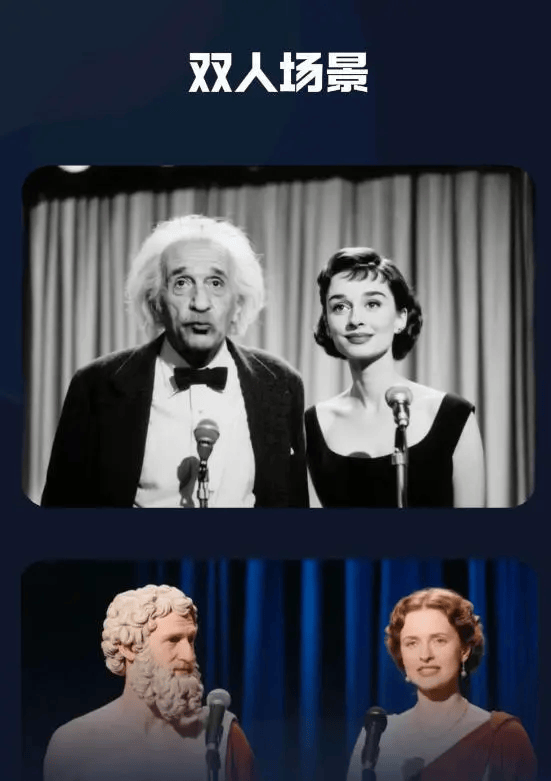

在功能方面,HunyuanVideo-Avatar突破了传统数字人技术仅支持头部动作的局限,实现了头肩、半身以及全身三种不同景别模式的全面支持。该技术还覆盖了赛博朋克、2D动漫、中国水墨画等多种艺术风格,并且能够驱动机器人、动物等多种角色,甚至处理双人或多人互动场景。

在腾讯音乐娱乐集团的多个核心产品中,HunyuanVideo-Avatar已经得到了实际应用。在QQ音乐平台上,当用户收听“AI力宏”的歌曲时,AI生成的虚拟形象会在播放界面实时同步演唱动作。酷狗音乐的长音频绘本功能则利用AI虚拟人讲述故事,为用户带来全新的听觉体验。而在全民K歌平台上,用户可以通过上传个人照片,生成专属的个性化唱歌视频。

从技术架构来看,HunyuanVideo-Avatar采用了多模态扩散Transformer(MM-DiT)作为其核心架构。该架构通过角色图像注入模块确保视频中人物的一致性,同时利用音频情感模块从声音和图像中提取情感特征,生成细腻的面部表情和肢体动作。针对多人场景,该技术还配备了面部感知音频适配器,利用人脸掩码技术实现多角色的独立精准驱动。

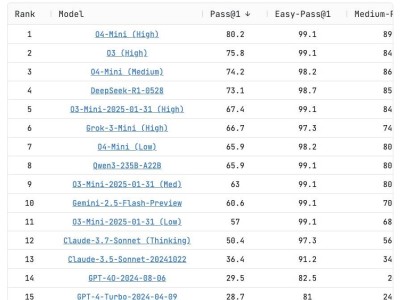

据官方介绍,HunyuanVideo-Avatar在主体一致性和音画同步准确度方面已经达到了业内领先水平,超越了现有的开源和闭源解决方案。在画面动态性和肢体自然度方面,该技术也与主流闭源方案处于同一技术水准。目前,HunyuanVideo-Avatar的单主体功能已经在腾讯混元官方网站开放体验,用户可以通过特定路径访问并尝试这一创新功能。系统当前支持上传不超过14秒的音频文件,未来还将逐步开放更多高级功能模块。