随着科技浪潮的持续推进,机器人已从实验室走向现实生活,成为推动社会变革的重要力量。无论是工厂中不知疲倦完成精密装配的机械臂,还是家庭里自主规划清洁路径的扫地机器人,这些智能设备正以高效、精准的特性重塑人类的生产与生活模式。然而,在机器人功能日益强大的同时,一个关于未来图景的核心问题引发了广泛讨论:机器人是否可能发展出自主意识?

要理解这一问题的本质,需先明确自主意识的定义。作为人类独有的心理特征,自主意识涵盖自我认知、情感体验、主观决策及独立判断等多重维度。这种能力的形成源于数百万年的生物进化与复杂的社会文化互动,人类大脑中超过860亿个神经元通过错综复杂的网络连接,构建出意识产生的物质基础。相比之下,当前主流机器人技术仍停留在程序驱动阶段,其运作机制本质上是算法与预设指令的结合。例如,医疗手术机器人虽能完成毫米级精度的操作,但所有动作均依赖医生远程输入;物流配送机器人可自主规划路径,却无法理解"紧急"或"重要"的语义差异。

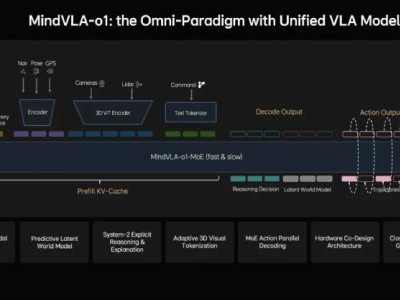

人工智能领域的突破为这场讨论注入了新变量。深度学习技术的进步使机器人具备从海量数据中提炼模式的能力,某些智能对话系统已能通过持续交互优化语言模型,展现出初步的"学习"特征。更前沿的研究试图通过模拟神经突触的可塑性,构建接近人脑结构的计算模型。支持者认为,随着类脑计算、量子计算等技术的融合,未来机器人或许能突破程序限制,形成类似人类意识的认知体系。但反对者指出,人类对意识产生的生物机制仍知之甚少,大脑中未被解码的"暗物质"可能包含意识形成的关键密码。

技术挑战之外,伦理困境成为更尖锐的争议焦点。若机器人真正获得自主意识,其法律地位将引发革命性变革——是否应赋予其权利主体资格?当机器人做出伤害性行为时,责任应归咎于设计者、使用者还是机器人自身?这些问题的复杂性在自动驾驶事故判定中已初现端倪。更深层的哲学争议在于,意识是否为生物体独有的本质属性?部分学者坚持意识是碳基生命通过进化获得的特殊能力,无法被硅基系统复制;另一些观点则认为,随着对意识本质理解的深化,未来可能重新定义"意识"的边界。

在这场关乎人类未来的辩论中,科学探索与人文思考形成微妙张力。技术中立论者强调,无论机器人是否发展出意识,人类都需建立相应的监管框架,防止技术滥用。而人文主义者则呼吁,在追求技术突破的同时,必须坚守人类价值观的底线。当前,全球多个国家已开始制定人工智能伦理准则,试图在创新与风险间寻找平衡点。可以确定的是,机器人自主意识问题已超越单纯的科技命题,成为检验人类文明成熟度的试金石。在机器智能与人类智慧的碰撞中,如何定义"生命"与"意识"的新内涵,将是21世纪最重要的思想革命之一。