谷歌正将其自研的AI芯片TPU推向更广阔的市场,这一举动不仅打破了原本局限于云端的芯片竞争格局,更对AI芯片领域的传统霸主英伟达构成了实质性威胁。据科技媒体The Information分析,全球最前沿的两个AI模型——谷歌与Anthropic的模型,均完全或部分基于TPU开发,而非依赖英伟达的GPU。这一趋势已促使英伟达的重要客户meta开始认真评估采用TPU开发新模型的可能性。

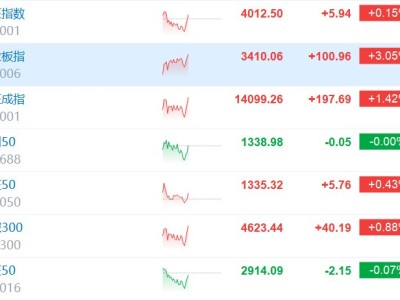

TPU的角色正从谷歌内部专用工具转变为被大型AI企业纳入战略考量的替代方案。摩根士丹利预测,谷歌计划在2026年生产超过300万片TPU,2027年产量将攀升至500万片,尽管英伟达当前GPU产量约为TPU的三倍,但差距正在逐步缩小。谷歌通过构建超大规模集群与优化性价比,正在动摇英伟达在定价权与市场主导地位上的根基。这场竞争的核心已从单芯片性能转向生态体系与商业模式的较量:英伟达凭借CUDA生态锁定用户,谷歌则试图通过TPU与Gemini模型的协同开辟新入口。

在算力指标上,谷歌最新代号Ironwood的TPU在每秒浮点运算次数(FLOPS)上约为英伟达Blackwell GPU的一半。但谷歌通过“集群化”策略弥补了这一差距——数千颗TPU可串联成“超级Pod”,在训练超大模型时展现出更高的性价比与能效比。相比之下,英伟达单个系统最多直接连接约256颗GPU,扩展规模需依赖额外网络设备。大模型时代下,系统级设计、互连能力与能效比正取代单芯片性能成为关键指标。

英伟达的真正护城河在于其深度绑定的CUDA软件生态。根据对谷歌与英伟达前员工的调研,TPU的使用成本与模型适配性密切相关:已采用CUDA编程的客户租用英伟达芯片更具成本优势,而愿意重写代码的开发者可通过TPU节省开支。对于Anthropic、苹果等技术实力较强的企业,使用TPU的挑战较小,尤其在运行谷歌优化后的Gemini模型时效率突出。然而,TPU仍面临软件兼容性瓶颈——其仅与TensorFlow等特定工具深度适配,而主流AI研究框架PyTorch在GPU上的运行效果更佳。工程师指出,若开发者为GPU编写定制软件,其性能可能超越TPU。

在制造成本层面,TPU与GPU的差距并不显著。Ironwood采用比Blackwell更先进的制程技术,但芯片体积更小,单片晶圆可切割更多TPU,部分抵消了成本劣势。两者均依赖高带宽内存(HBM),而博通在封装设计与SerDes(高速数据传输核心技术)等关键环节扮演重要角色。据分析机构估算,博通从TPU项目中获得的收益至少达80亿美元。值得注意的是,英伟达硬件业务毛利率高达63%,远超谷歌云24%的整体毛利率,这使其在价格竞争中仍保持强劲盈利能力。

晶圆代工端的产能博弈也在重塑市场格局。台积电并未将全部产能倾斜于单一客户,即使英伟达需求旺盛,也难以获得无限供应。这种平衡策略为TPU等替代方案留出了市场空间。摩根士丹利预测,谷歌TPU产量将在未来两年持续攀升,与英伟达的差距进一步缩小。供应多元化趋势下,客户更倾向于比较选项、分散风险并争取议价权。

若谷歌计划大规模对外销售TPU,需重建涵盖服务器制造、分销网络与企业级售后支持的完整产业链,这几乎等同于“复制一个英伟达”。客户将TPU部署于自有数据中心可能导致谷歌损失部分云服务收入(如存储与数据库服务),因此TPU未来可能不会采取低价策略,而是通过其他服务费用弥补收入缺口。这场竞争的本质并非单纯的价格战,而是涉及战略布局的复杂博弈。

对谷歌而言,TPU的战略价值远超硬件收入本身。它既是与英伟达谈判的筹码,也是推广Gemini模型及AI生态的关键工具,更赋予谷歌在AI基础设施领域更大的自主权。只要客户愿意增加选择,英伟达的绝对定价权便将受到制约——这或许才是谷歌布局TPU的终极目标。