随着谷歌最新一代AI芯片Gemini 3的发布,其自主研发的TPU(张量处理单元)正从幕后走向聚光灯下。这款芯片的推出不仅引发行业震动,更让英伟达在AI加速芯片领域的统治地位面临挑战。市场消息显示,谷歌正通过多种举措加速TPU的市场渗透,甚至有分析预测其外销量将在未来几年突破百万颗。

据知情人士透露,谷歌云部门已制定明确目标:通过扩大TPU的市场份额,从英伟达手中夺取约10%的年度营收。这一战略意图迅速在产业链引发连锁反应,近期陆续有"谷歌加大TPU推广力度"、"meta计划斥资数十亿美元采购TPU"等市场传闻浮现。摩根士丹利分析师更是给出激进预测,认为到2027年谷歌TPU的外部销售量将达到100万颗。

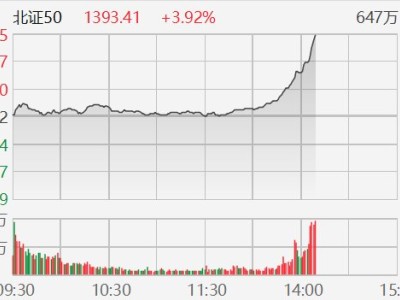

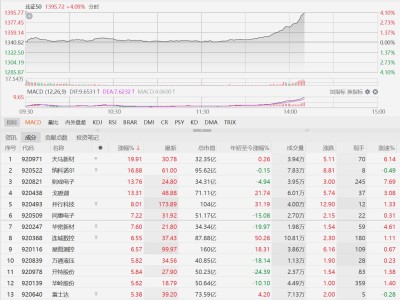

资本市场对此反应强烈,英伟达股价出现波动。为稳定投资者信心,英伟达紧急发布声明,强调其GPU产品在性能、通用性和可替代性方面仍具有显著优势。这场芯片巨头的暗战,将AI加速领域的竞争推向新高潮。

追溯TPU的发展历程,其诞生源于谷歌十二年前面临的"算力危机"。2013年,随着深度学习技术在谷歌内部广泛应用,模型复杂度呈指数级增长。首席科学家Jeff Dean的计算显示,若1亿安卓用户每日使用3分钟语音转文字服务,所需算力将超过谷歌全球数据中心总和的两倍。传统GPU方案因"冯·诺依曼瓶颈"在处理大规模矩阵运算时效率低下,促使谷歌转向专用芯片研发。

谷歌的研发团队展现出惊人效率。由数据中心硬件部门牵头,联合Google Brain和DeepMind团队,仅用15个月就完成初代TPU从设计到部署的全流程。这款芯片采用独特的脉动阵列架构,虽然牺牲了部分通用性,但在深度学习推理任务中能效比提升达十倍。2016年,搭载初代TPU的AlphaGo击败围棋世界冠军李世石,让TPU首次进入公众视野。

2017年成为关键转折点。谷歌提出的Transformer架构与TPU设计高度契合,推动TPU从专用加速芯片升级为AI基础设施核心。同年开放的1000台Cloud TPU资源,进一步巩固了其生态地位。后续版本通过引入液冷技术和环形拓扑网络,实现4096颗芯片的无损互联,性能持续突破。

在技术迭代的同时,谷歌将TPU深度整合至核心业务。从广告系统到搜索排序,TPU支撑着谷歌最赚钱的产品线。在2024年的开发者峰会上,谷歌明确表示,新一代TPU将聚焦推理场景的成本优化,目标成为"最经济的商业引擎"。这种垂直整合战略,使谷歌构建起从芯片到应用的完整AI能力链。

分析人士指出,谷歌的成功在于其独特的"成本优先"策略。早在2006年,谷歌就开始探索神经网络专用芯片,但直到数据中心算力压力显现才实际推进。这种务实作风体现在TPU的极简设计上——通过剥离非必要功能,在特定领域实现极致效率。这种选择虽然限制了硬件通用性,却换来了难以复制的生态优势。

如今,谷歌已形成"芯片-云服务-基础模型-应用场景"的闭环生态。与其他依赖第三方算力的厂商不同,这种全栈能力构建起坚固的竞争壁垒。券商研究显示,谷歌的垂直整合模式不仅降低运营成本,更使其在AI基础设施定义权争夺中占据先机。随着Gemini 3等模型的推出,这场由芯片引发的产业变革,正在重塑AI领域的竞争格局。