在人工智能领域,大型视觉语言模型凭借“看图说话”的能力备受关注,但高昂的内存和算力需求却成为其广泛应用的一大阻碍。这类模型若部署在手机、车载系统等资源有限的设备上,往往面临“水土不服”的困境。为解决这一问题,李想汽车研究团队提出了一种名为Switch-KD的创新蒸馏框架,为模型轻量化提供了新思路。

传统知识蒸馏技术通过“老师模型”向“学生模型”传递知识,已在纯文字AI领域取得显著成效。然而,视觉语言模型需同时处理图像和文字信息,知识传递的复杂性大幅增加。现有方法多聚焦于语言输出阶段的监督,对视觉信息的传递监督不足,导致视觉与语言知识传递缺乏内在一致性。

Switch-KD框架的核心突破在于将视觉与语言知识统一到语言概率空间进行传递。其设计灵感源于一个生动的场景:让老师模型通过学生模型的“眼睛”观察世界,并对比两者对图像的解读差异。具体而言,学生模型的视觉编码器输出图像特征后,这些特征会被“切换”至老师模型的投影器和语言大脑,生成一组概率预测。通过比较这组预测与老师模型自身视觉输入的输出,可量化视觉知识传递的损失,从而实现无需额外模块的统一监督。

为进一步提升蒸馏效率,研究团队设计了动态双向逻辑差异损失函数(DBiLD)。该函数针对语言模型输出的“长尾分布”特性,通过Kneedle算法动态确定高价值信息区域的边界,自动调整参与对比的词汇数量。与传统固定阈值方法不同,DBiLD通过比较老师和学生在高概率词汇上的相对排序差异,而非绝对概率值,使知识传递更聚焦于模型的核心判断逻辑。该函数采用双向验证机制,既以老师模型为基准约束学生,也以学生模型的自信判断反哺老师,形成闭环优化。

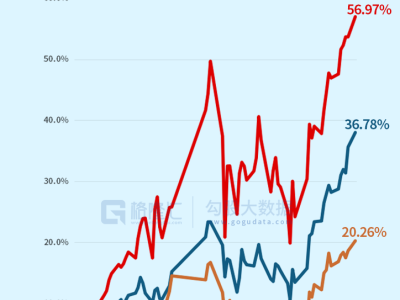

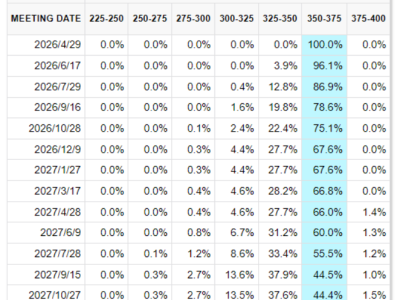

实验结果显示,Switch-KD框架显著提升了小模型的性能。在10个权威测试基准上,5亿参数的学生模型综合评分达60.1分,较同规模基线模型提升3.6分。尤其在处理模糊照片等复杂视觉任务时,其表现优于纯标准对齐蒸馏方法3.4分。中等规模模型(15亿参数)在减少76%训练数据的情况下,仍取得比对比方法高4.4分的成绩。注意力图可视化进一步证实,Switch-KD训练的学生模型能更精准地捕捉图像语义核心区域,接近老师模型的表现水平。

消融实验深入验证了各设计模块的有效性。加入视觉切换机制后,模型得分提升1.3分,其中模糊照片处理任务提升最显著;DBiLD损失函数的动态k值选择、反向KL散度及双向结构设计,共同贡献了2.3分的提升;蒸馏阶段的选择实验表明,在微调阶段引入Switch-KD可获得最佳效果,避免预训练阶段蒸馏的边际效益递减问题。实验还揭示了老师模型规模与学生容量的匹配规律:当学生模型较小时,过大的老师模型反而可能因知识过载导致性能下降。

尽管Switch-KD在模型轻量化领域取得进展,但其应用仍受限于架构同质性要求。当前框架要求老师与学生模型共享特征空间和词汇表,难以直接应用于异构模型间的知识传递。研究团队正探索引入适配器层或开发架构无关的蒸馏方法,以扩展Switch-KD的适用范围。这一方向若取得突破,将进一步推动AI模型在资源受限设备上的部署,为智能终端的本地化AI应用提供技术支撑。

对于普通用户而言,这类研究意味着更高效的智能设备体验。经过Switch-KD优化的5亿参数模型,已在图像理解任务上展现出接近更大模型的性能,且具备响应速度快、隐私保护强等优势。随着技术迭代,未来更多AI功能有望脱离云端依赖,在本地设备上实现即时运行,为日常生活带来更多便利。

Q&A

Q1:Switch-KD如何实现视觉与语言知识的统一传递?A:该框架通过“视觉切换”机制,将学生模型的图像特征输入老师模型的语言处理通路,生成概率预测。通过比较这一预测与老师模型自身视觉输入的输出,在语言概率空间内量化视觉知识传递的损失,从而避免单独设计视觉特征对齐模块。

Q2:DBiLD损失函数如何动态确定参与对比的词汇数量?A:函数采用Kneedle算法分析词汇概率分布曲线的拐点,将曲线从陡峭到平缓的临界位置对应的排名序号作为动态k值。该方法根据不同样本的输出分布自动调整k值,确保仅聚焦于高概率词汇区域,排除低价值噪声干扰。

Q3:为何选择在微调阶段而非预训练阶段进行蒸馏?A:实验表明,预训练阶段蒸馏仅带来0.9分的提升,而微调阶段蒸馏可提升2.3分,且双阶段蒸馏未产生累加收益。因此,研究团队采用“预训练+蒸馏微调”的两阶段方案,以平衡训练效率与蒸馏效果。