一项由巴勒斯坦研究机构提出的新技术,正在为人工智能语言模型的训练效率带来突破性提升。这项被称为“三相变换器”(3PT)的方法,通过借鉴19世纪电力工程中的三相交流电原理,将语言模型内部的信息处理方式重新设计,实现了训练速度提升近一倍、模型质量显著改善的效果。相关研究以预印本形式发布,论文编号为arXiv:2604.14430,为AI领域提供了新的技术思路。

传统AI语言模型的核心架构是Transformer,其运作机制类似于一条“信息高速公路”:每个词语经过处理后转化为高维数字向量,在模型中流动并完成计算。如何优化这条高速公路上的信息流动,一直是研究者关注的重点。三相变换器的创新之处在于,它将原本单一的信息通道拆分为三条并行的“车道”,并让这三条车道以类似三相电的方式协同工作。具体而言,每个词语的向量被均匀分为三段,分别称为“A相”“B相”“C相”,每段各占总长度的三分之一。通过精心设计的操作,这三段信息在模型处理过程中保持动态平衡,从而提升整体效率。

这一设计的核心操作包括四类:首先是“相位旋转层”,它被插入到模型的每个处理单元中,对三段信息分别施加120度间隔的旋转变换,确保三者之和始终为零;其次是“相位感知归一化”,将传统的整体归一化操作改为对三段信息分别处理,避免相互干扰;第三是“相位对齐的注意力机制”,通过调整注意力头的数量使其能被三整除,确保每个注意力头完整落在某一相位分段内;最后是“加布里埃尔号角注入”,利用数学曲线为模型注入绝对位置信号,弥补现有技术在位置编码上的不足。

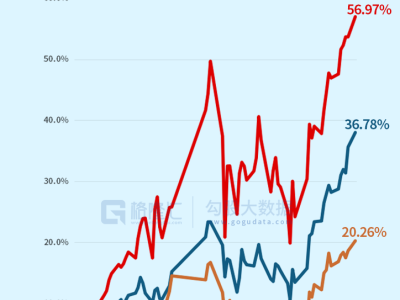

实验数据显示,这套方法在轻量化方面表现突出。在一个拥有1.23亿参数的标准语言模型上,三相结构仅增加了1536个可训练参数,占总参数量的0.00124%。然而,这种微小的改动带来了显著效果:模型在标准测试集WikiText-103上的困惑度下降了7.20%,同时训练达到相同质量所需的步骤数减少了近一半,收敛速度提升至1.93倍。更令人惊讶的是,这种改进并非通过增加模型复杂度实现,而是通过优化信息流动的几何结构达成。

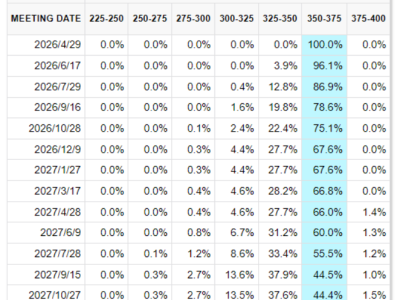

位置编码的优化是三相变换器的另一大亮点。现有主流模型普遍采用RoPE技术编码词语间的相对位置关系,但对绝对位置的处理较为模糊。三相结构开辟的“直流隧道”为解决这一问题提供了新途径。研究者将“加布里埃尔号角”数学曲线注入这一通道,该曲线的值随词语位置递减,且总和增长极慢,确保无论序列多长,注入的总能量始终有限。这种设计既编码了“开头特殊、后面模糊”的语言直觉,又与RoPE的工作空间完全正交,两者互不干扰且相互补充。实验证明,叠加使用三相结构和RoPE的模型,困惑度比单独使用RoPE的模型降低了15%。

这项研究的探索过程并非一帆风顺。初期实验中,三相结构在传统Transformer架构上表现优异,但在移植到采用RoPE的现代架构时却效果不佳。研究者通过重新审视发现,三相结构和RoPE并非竞争关系,而是可以叠加使用的工具。这一认知转折推动了后续实验的优化,最终形成了精简后的三相变换器方案。实验还发现,随着模型规模的扩大,三相结构的优势更加明显,但在123M参数规模下,分段数N=1和N=3的性能差异在统计上无法区分,表明“三相”并非绝对最优,而是提供了参数共享的灵活选择。

三相变换器的自我稳定性也令人瞩目。即使去掉所有显式的平衡约束,模型在训练过程中仍能自发维持三个相位的均值接近,波动幅度仅为激活值的1%。这种特性与物理学中的诺特定理相呼应:相位旋转层创造的旋转对称性和相位归一化创造的尺度不变性,共同产生了约束相位均值的守恒量,使得梯度下降过程自然维持平衡。研究者在12层模型中还发现,相位旋转层的可学习角度参数在训练后呈现出“U形”分布规律,揭示了线性初始化策略的局限,为未来改进提供了方向。

从550万参数到1.23亿参数的跨规模验证表明,三相变换器的效果具有可重复性。在123M参数规模下,模型的困惑度从17.31降至16.06,降幅7.20%;用BPB指标衡量,降幅为2.62%。尽管与一些经过专门微调的GPT-2家族模型相比仍有差距,但研究者强调,真正的对比应基于配置完全相同、仅变量不同的RoPE基准模型实验。这项研究的意义不仅在于提供了一个“训练快一倍”的技巧,更在于展示了如何将外部知识转化为模型架构约束的方法论,为AI开发效率的提升提供了新思路。