人工智能领域正经历一场关键转折,行业领军人物Ilya Sutskever近日公开指出,单纯依赖模型规模扩张的发展模式已触及瓶颈,未来突破将聚焦于架构层面的智能化革新。这一论断引发全球科研机构的深度反思,过去数年"堆数据、增参数"的技术路线逐渐显现边际效应递减的困境,促使学界将目光转向底层架构创新。

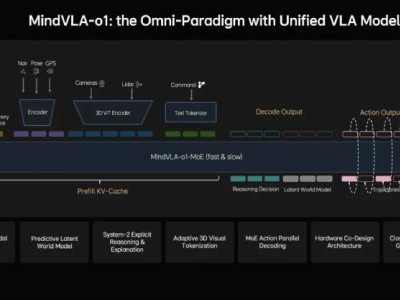

在此背景下,中国科研团队推出的开源多模态架构NEO引发广泛关注。该模型突破传统多模态系统的拼接式设计,构建了视觉与语言深度融合的统一框架。相较于GPT-4V、Claude 3.5等主流模型采用的视觉编码器与语言模型分离架构,NEO通过原生整合机制实现了跨模态信息的无缝流通,有效解决了传统系统存在的信息传递损耗问题。

技术层面,NEO实现了三项关键突破:其原生图块嵌入技术直接从像素级构建视觉表征,显著提升了图像细节的解析能力;三维旋转位置编码系统通过高频低频信号的动态组合,精准捕捉图像与文本的空间关系;改进后的多头注意力机制使视觉语言信息在统一框架内高效交互,大幅增强了对复杂语义的解析能力。这些创新使模型在架构层面实现了质的飞跃。

实验数据显示,NEO在保持训练数据量仅为传统模型十分之一的情况下,于多项基准测试中达到甚至超越旗舰级对手的表现。这种数据效率的革命性提升,不仅验证了原生架构的技术优势,更为AI发展开辟了新路径。该成果表明,通过优化模型架构设计,可以在显著降低资源消耗的同时实现性能突破,为可持续的AI发展提供了重要范式。