当AI视频编辑工具逐渐走进大众视野,人们惊叹于它们将晴天变暴雪、把草原改沙漠的神奇能力。然而,一个关键问题始终困扰着行业:这些工具生成的编辑结果,究竟质量如何?传统评估方式要么依赖人工逐帧检查,耗时费力;要么使用通用AI模型充当“裁判”,却难以精准把握视频编辑的专业要求。针对这一痛点,一支跨机构研究团队构建了一套完整的评估体系,为AI视频编辑质量提供了多维度的量化标准。

评估视频编辑质量并非易事。与文字评分不同,视频编辑需要同时满足三个核心指标:指令跟随、渲染质量与编辑独占性。指令跟随要求模型严格按用户要求修改内容;渲染质量关注画面是否清晰流畅;编辑独占性则强调修改范围是否精准,避免误伤无关区域。这三个维度相互独立,一个工具可能生成逼真的香蕉图像,却意外改变了背景桌布的颜色;另一个工具可能精准定位修改区域,但输出的香蕉形似模糊色块。传统单一评分体系无法捕捉这种复杂性,导致评估结果失真。

为破解这一难题,研究团队打造了包含5049个案例的VEFX-Dataset数据集。该数据集覆盖自然风光、人物、街景等10类场景,所有视频分辨率不低于720p,帧数超过40帧。编辑指令涵盖9大类任务,包括实例编辑、风格转换、特效添加等32个子类。团队采用混合生成策略,结合商业系统与开源模型,甚至开发专用编辑流水线,确保数据集包含多样化的质量水平与失败模式。每个案例均由专业标注员对三个维度独立评分,并通过可靠性测试验证标注一致性,指令跟随、渲染质量、编辑独占性的评分一致率分别达到93.5%、97.2%与91.7%。

数据分析揭示了AI视频编辑的现状。指令跟随呈现两极分化,41.2%的案例得最低分1分,28.1%得最高分4分,显示工具在理解指令方面表现不稳定;渲染质量整体较好,78.6%的案例获3分或4分,表明视觉流畅性已非主要瓶颈;编辑独占性分数分布均衡,反映精准控制修改范围仍是普遍挑战。任务难度分析显示,摄像角度编辑最难,指令跟随平均分仅1.76分;风格编辑最易,平均分达2.87分,但该类任务的编辑独占性得分较低,说明工具常过度修改无关区域。

基于数据集,团队训练了VEFX-Reward评分模型。该模型采用多模态架构,输入原始视频、编辑指令与修改后视频,输出三个维度的分数。为提升评分准确性,模型引入三个专用问询标记,分别聚焦指令跟随、渲染质量与编辑独占性,并采用序数回归方法预测分数等级。实验表明,320亿参数版本的VEFX-Reward在斯皮尔曼秩相关系数等指标上全面领先,组内偏好准确率达0.872,显著优于通用大模型与现有专用评分工具。

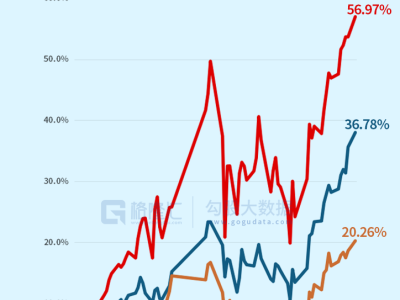

应用VEFX-Reward对10款主流工具的评测显示,Kling o3 omni综合表现最佳,几何加权综合分达3.057分,其在指令跟随与渲染质量上优势明显;Grok Imagine编辑独占性得分最高,但指令跟随较弱,综合排名第五;开源工具UniVideo表现优于VACE,尤其在编辑独占性上接近商业系统水平。任务类型雷达图进一步揭示,不同工具擅长领域差异显著:Kling o3 omni在数量与属性编辑上领先,Grok Imagine擅长风格与实例编辑,用户需根据具体需求选择工具。

为推动行业标准化,研究团队还发布了VEFX-Bench测试题库,包含300个精心设计的(原始视频,编辑指令)配对,覆盖各类编辑任务与难度级别。该题库为不同工具的横向对比提供了统一基准,确保评测结果的可比性与可复现性。这项研究通过构建数据集、评分模型与测试题库,为AI视频编辑领域建立了首个多维度的量化评估框架,为工具开发者与用户提供了客观、透明的质量衡量标准。