香港中文大学(深圳)联合深圳湾区研究院、北京科技大学及DualityRL团队,在人工智能推理效率领域取得突破性进展。其提出的"路径剪枝"技术通过提前终止无效推理路径,在保持答案准确率的同时将计算量降低超70%。这项名为STOP(Super TOken for Pruning)的技术方案,以预印本形式发表于arXiv平台(编号2604.16029v1),为解决大型推理模型高能耗问题提供了新思路。

传统AI推理采用"并行试错"机制,同时运行数十条推理路径后投票选出最优解。这种模式虽能提升答案可靠性,但单次查询成本高达6美元。研究团队发现,约60%的推理路径在初始阶段就已偏离正确方向,却仍会消耗大量算力完成全流程计算。这种"无效劳动"不仅造成资源浪费,错误路径的投票权还可能拉低最终答案质量。

技术核心在于构建"推理质量评估插件"。该系统通过新增[STOP]特殊标记,实时捕获AI内部状态信息,经轻量化LoRA适配器转换后,由分类器输出0-1的路径质量评分。整个评估过程复用已有计算缓存,额外耗时不足原始推理的1%。实验数据显示,在15亿参数模型处理AIME 2024数学题时,STOP技术使准确率从30.1%提升至37.92%,同时减少73.88%的计算量。

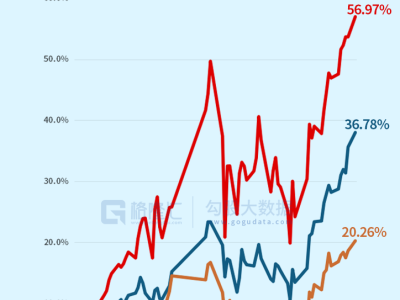

研究团队建立的双维度分类框架,将现有剪枝方法划分为四类:外部信号+固定规则、外部信号+可学习、内部信号+固定规则、内部信号+可学习。其中,同时利用内部状态与可学习机制的STOP方案,在五个不同难度基准测试中均表现最优。特别是在HMMT 2025数学竞赛数据集上,该方法在仅保留12.5%路径的情况下,仍维持了原始准确率。

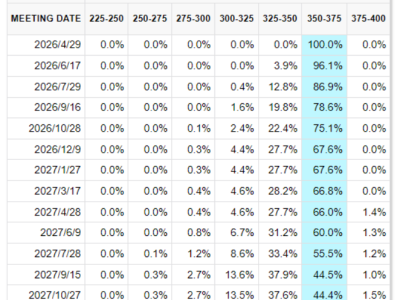

动态保留比例算法是该技术的另一创新。通过分析算力预算、前缀长度与任务复杂度的数学关系,研究团队推导出最优剪枝比例公式。实际应用中,用户可根据预设表格直接查询参数,无需反复调试。在AIMO3竞赛系统实测中,接入STOP的1200亿参数模型在5小时时限内完成50题,得分从39分提升至43分,达到银牌标准。

注意力可视化分析揭示了STOP的评估逻辑。该系统重点关注推理文本中的逻辑转折词(如"don't")和结构标记(如"therefore"),而非直接盯住答案选项。对低质量路径,系统会捕捉其过早聚焦答案选项的特征,将其判定为"投机取巧"行为。这种过程导向的评价机制,使STOP具备跨领域适用性,在ZebraLogic逻辑谜题测试中,答案准确率提升4个百分点。

技术实现细节显示,STOP采用蒙特卡洛软标签训练法,通过32次续写采样估算路径成功概率。这种标注方式比传统二元标签更具稳定性,使模型能学习到路径的"潜力概率"而非单次结果。研究团队已开放训练数据集与模型权重,普通研究者可直接下载使用,避免了重复构建数据的高昂成本。

当前技术仍存在改进空间。研究团队指出,在700亿参数以上模型和超大规模路径采样场景中,STOP的性能尚未验证。现有方案仅支持固定位置的单阶段剪枝,未来可探索多时间点分级筛选策略。这些局限性为后续研究指明了方向,相关技术细节可在arXiv平台获取完整论文。